在如今这个全民直播的时代,声音的清晰度和稳定性,往往直接决定了观众的去留。我们可能都遇到过这样的尴尬瞬间:主播的声音夹杂着恼人的回声,忽大忽小的音量让人不得不频繁调整设备,或是背景里持续的键盘敲击声、空调风声让人心烦意乱。这些看似微小的问题,背后其实都指向了同一个核心技术——音频处理。那么,对于想要出海的直播应用开发者而言,他们所依赖的海外直播SDK,其音频处理模块是否内置了解决这些问题的“灵丹妙药”——3A算法(AEC, AGC, ANS)呢?答案是肯定的,而这背后蕴含的技术细节与应用价值,远比想象中要丰富和重要。

深入了解3A算法

在我们探讨SDK如何支持3A算法之前,不妨先花点时间,用生活化的方式来理解这三个听起来有些“高冷”的缩写词究竟是什么。它们是保证我们在线沟通时,声音能够“听得清、听得真”的幕后英雄。

声学回声消除 (AEC)

想象一个场景:你正在和一个朋友视频连麦。你的声音从他的手机扬声器里播放出来,然后又被他的麦克风捕捉到,再传回你的耳朵里。于是,你就听到了自己刚刚说过的话,这就是“回声”。如果有多个人同时连麦,此起彼伏的回声会让整个直播间变得混乱不堪。声学回声消除(Acoustic Echo Cancellation, AEC)技术就是为了解决这个问题而生的。

它的工作原理,可以通俗地理解为一个聪明的“声音过滤器”。AEC算法会实时分析从远端传过来的音频信号(即你朋友听到的你的声音),并将其作为参考。当朋友的麦克风采集到包含了回声的混合音频时,AEC会精准地从这个混合音频中,将它已经“记住”的参考信号(也就是你的回声)给“减去”,只留下朋友真实的声音。这个过程需要极高的计算精度和极低的时延,尤其是在双方同时说话(即“双讲”)的复杂情况下,优秀的AEC算法能做到既消除回声,又不损伤正常对话的流畅性,这正是像声网这样的专业服务商投入大量研发精力的地方。

自动增益控制 (AGC)

另一个常见问题是音量“飘忽不定”。有的主播习惯离麦克风很近,声音洪亮;有的则可能在直播过程中来回走动,导致声音时远时近。观众的耳朵就要经受这种“忽高忽低”的折磨。自动增益控制(Automatic Gain Control, AGC)就像一位随身调音师,它的任务就是将音频信号维持在一个相对稳定舒适的响度范围内。

当输入的音量太小时,AGC会自动调高麦克风的增益,放大声音,确保远端的听众也能听清;当输入的音量过大,甚至快要产生破音(削波失真)时,它又会迅速调低增益,防止声音刺耳。一个成熟的AGC算法,其调整过程是平滑且不易察觉的,它追求的不是绝对的音量一致,而是一种动态的平衡,既保留了说话人自然的语气起伏,又避免了极端响度变化带来的不适感。

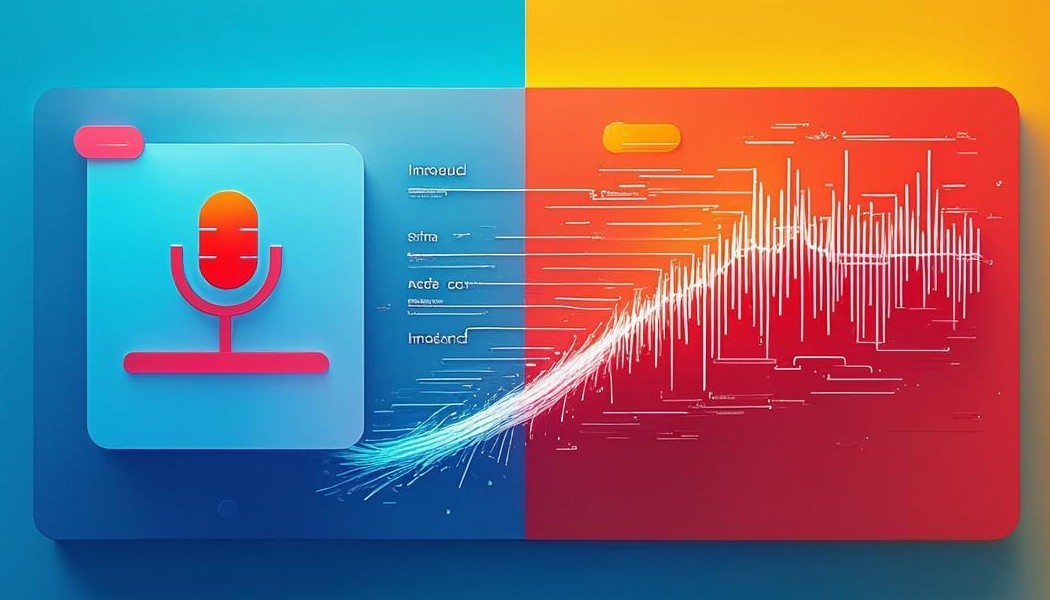

自动噪声抑制 (ANS)

背景噪音是直播中的“常客”,无论是窗外的车水马龙、办公室的键盘敲击声,还是设备自身的电流声,都会严重干扰语音的清晰度。自动噪声抑制(Automatic Noise Suppression, ANS),或称降噪,其目的就是“去粗取精”,从嘈杂的环境音中提取出干净的人声。

传统的ANS算法主要针对比较平稳的噪声,比如风扇声、空调声。但随着技术的发展,尤其是AI技术的融入,现代降噪技术已经进化到了一个全新的高度。例如,声网所提供的AI降噪能力,能够通过深度学习模型,精准识别并分离人声和多达数百种的非人声噪声,即使是瞬时的、不规律的噪声(如敲门声、狗叫声)也能有效抑制。这种智能降噪,在最大程度保留说话人音质和情感的同时,为听众营造出身临其境般的纯净听感。

SDK对3A算法的集成与支持

对于应用开发者来说,从零开始实现一套高性能、低功耗且兼容性好的3A算法,无疑是一项浩大的工程。因此,一个成熟的海外直播SDK是否原生、深度地集成了这些功能,并提供便捷的调用接口,是衡量其技术实力的关键标准。

为何集成是必然选择

在快节奏的应用开发周期中,效率就是生命。如果开发者需要自行处理底层的音频采集、算法集成、多平台适配等一系列复杂问题,不仅会极大地延长产品上线时间,而且最终的效果也很难得到保证。音频算法的优化是一个需要长期积累和海量数据进行模型训练的领域,这对于大多数应用团队来说,成本过高。

因此,选择一个像声网这样,将经过市场检验的3A音频算法作为标准功能内置于SDK中的服务商,就成了一条捷径。开发者无需关心算法的具体实现,只需通过简单的API调用,就能为自己的应用赋予强大的实时音频处理能力。这不仅降低了技术门槛,也让开发者能更专注于核心业务逻辑和用户体验的创新。

灵活的API与可配置性

优秀的SDK不仅要提供功能,更要提供灵活性。不同的直播场景对音频处理的需求不尽相同。例如,在语音聊天室中,我们希望3A算法火力全开,保证对话的清晰流畅;但在音乐直播或在线K歌场景中,过度开启AEC或ANS可能会对乐器声音或歌声造成不必要的损伤。因此,SDK必须提供足够精细的控制选项。

通常,一个设计良好的SDK会提供如下所示的控制能力,让开发者可以根据业务需求,动态地开启、关闭或调整3A算法的模式和强度。

| 功能模块 | 控制API(示例) | 应用场景建议 |

|---|---|---|

| 声学回声消除 (AEC) | enableAEC(true/false) |

默认开启。在所有涉及连麦、多人互动的场景中必须开启。单人直播时可关闭。 |

| 自动增益控制 (AGC) | enableAGC(true/false) |

建议开启。适用于大部分语音通话和直播场景,以统一不同用户的音量。专业录音或音乐场景可选择关闭,由主播自行控制音量。 |

| 自动噪声抑制 (ANS) | setANSMode(mode)(如:关闭、低、中、高、AI模式) |

按需选择。日常聊天可选“中”模式;在嘈杂环境(如户外、展会)直播时,应开启“高”或“AI”模式,以获得最佳降噪效果。 |

通过这种方式,SDK将复杂的技术实现封装在底层,同时把简单易用的控制权交到开发者手中,实现了技术专业性与业务灵活性的完美结合。

总结与展望

回到我们最初的问题:海外直播SDK的音频处理模块是否支持3A算法?答案是明确的,不仅支持,而且已经成为衡量其服务质量的核心指标之一。AEC、AGC和ANS这三大算法,如同音频世界里的“稳定器”、“净化器”和“平衡器”,共同构筑了清晰、纯净、舒适的实时互动体验基石。

对于出海开发者而言,选择一个在音频技术上有着深厚积累,并能提供如声网般稳定、易用、功能强大的SDK,意味着在产品起步阶段就拥有了世界一流的音频沟通能力。这不仅能显著提升用户满意度和留存率,更是在激烈的全球市场竞争中,建立品牌口碑、赢得用户信赖的关键所在。

展望未来,随着AI技术的不断演进,音频处理正变得越来越“智能”。未来的SDK或许不仅能消除噪音,更能理解场景,自动适配最佳的音频效果。例如,在会议中自动增强主讲人的声音,在音乐直播中智能识别并美化乐器声。技术的边界在不断拓宽,但其核心目标始终未变——让每一次在线沟通,都如面对面般真实、自然。