2026年第一季度,开源语音AI迎来了集中爆发。NVIDIA Parakeet RNNT 在 LibriSpeech 基准上把词错率(WER)压到了 1.8%,与顶级商用 ASR 几乎没有差距;Hume AI 开源了 TADA,用一种新的 token 对齐架构从根本上解决了 TTS 长文本幻觉的问题;Mistral 发布 Voxtral TTS,4B 参数,开源权重,只需 3 秒参考音频就能完成零样本声音克隆。加上 Gemini 3.1 Flash Live、OpenAI gpt-realtime 同期持续迭代,语音 AI 的模型层在这个时间段密度之高,几乎前所未有。

对开发者来说,自建 ASR 变得现实,自建 TTS 也有了足够好的开源方案,不再非得依赖某家云 API 。但选择多了之后,真正难的问题也随之浮现:模型选好了,如何让它稳定地跑到全球用户面前?

一. 开源模型爆发,语音AI的自建时代到来

语音 AI 的技术状态在 2026 年已经发生了根本性变化。过去,开源方案和商用 API 之间存在明显差距,如声音不够自然、识别准确率差几个百分点、长文本容易出错。这些差距让很多团队放弃自建,直接付费调用 ElevenLabs、Deepgram 或 OpenAI 的 API。

今年这个局面被几款开源模型改变了。

- NVIDIA Parakeet RNNT:采用 Cache-Aware FastConformer 架构,通过缓存历史帧、只处理新增音频的方式消除了传统流式 ASR 的冗余计算。

- Hume TADA:传统 LLM-TTS 系统每秒音频需要生成 12.5 到 75 个音频帧,但对应的文字 token 只有 2 到 3 个,这种速率不匹配会导致模型跳词、插词或生成偏离原文的内容。TADA 的做法是强制让文本 token 和音频帧保持 1:1 对齐,从架构上切断了幻觉发生的可能。

- Mistral Voxtral TTS: 它 4B 参数,开源权重可以直接下载自托管,零样本声音克隆的人工评测中,Voxtral TTS 以 68.4% 的胜率优于 ElevenLabs Flash v2.5,同时把数据完全控制在自己手中。

三款模型,各自在解决语音链路的不同环节。叠加来看,开发者第一次有了组建完整开源语音全栈的条件:自选 ASR 换掉 Deepgram、自选 TTS 换掉 ElevenLabs、自选 LLM,不被任何单一供应商锁定。

二. 模型在手,距离上线还差什么

模型层的自由度提升,并没有让语音 Agent 的落地变得更简单。开源模型拿到手的是一组权重文件,不是一个可以直接服务用户的系统。从权重到产品可用,中间有一段工程距离。

模型延迟和用户感知延迟,是两件事

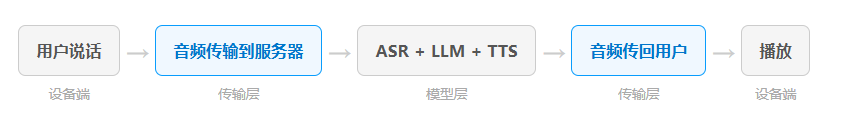

Parakeet 的 ASR 中位转录延迟是 24ms,Voxtral TTS 的首帧延迟约 90ms,这些都是模型侧的数字,测量的是从收到输入到给出输出的时间。但用户感知到的延迟,是整条链路的总和:

弱网或跨国场景下,传输层的往返延迟轻松超过 300ms,完全可以把模型层省下来的时间吃掉。

自建意味着你要自己搞定的事情变多了

把自托管模型做成生产可用的服务,需要处理的事情包括:GPU 资源的部署和弹性扩缩、全球不同地区用户的就近接入、弱网下的抗丢包机制、打断时的缓冲清空逻辑、多端(App / Web / IoT 硬件)之间的兼容性。每一项叠加起来的工程量却相当 庞大。

尤其是打断处理,用户说话时打断 AI,不只是 VAD(语音活动检测)的问题。打断信号需要立即传到服务器,服务器需要立刻停止 TTS 生成,同时清空已经在传输路上的音频包,否则 AI 还会继续播放已经发出去的内容。这个协同需要模型层和传输层同时配合解决。

部署方式越多,基础设施的要求越高

开源模型带来的另一个变化是部署方式的多样化:纯云端部署、边缘节点部署、私有云部署、甚至混合部署。不同场景的选择不一样,金融、医疗团队可能要求模型跑在私有机房里,IoT 硬件可能需要边缘推理,出海产品需要模型跑在离用户近的区域。

但无论哪种部署方式,有一件事是不变的:用户端和模型端之间,音频需要可靠、低延迟地来回流动,但模型层本身解决不了。

三. RTC 基础设施在这条链路里做什么

提到 RTC(实时通信)基础设施,很多人的第一反应是视频会议用的那套东西。但对话 AI 场景对传输的要求,远比视频会议严苛。

视频通话里,500ms 的端到端延迟用户通常还能接受。对话 AI 不一样,用户说完话,超过 300ms 没听到回复,就会感觉 AI 在卡顿。这个阈值比人对人的语音通话更低,因为大脑已经习惯了和真人说话几乎没有停顿,对 AI 的期待也被这个模式校准了。

专门为实时交互设计的传输网络,和通用云基础设施之间的差距,正好体现在这里。

声网的 SD-RTN™(软件定义实时网络)覆盖全球 200 多个国家和地区,250 多个数据中心,所有边缘节点以秒级频率互相探测链路质量,实时选择延迟最低的传输路径。全球端到端延迟的中位数为 76ms,上限控制在 400ms 以内。在对话 AI 场景下,语音对话端到端延迟中位数为 650ms(这是从用户说完话到听到 AI 回复的完整时长,包含了 ASR、LLM、TTS 所有环节)。

弱网处理是另一个关键点。声网通过 FEC(前向纠错)和 NACK(选择性重传)双重机制对抗丢包:丢包率较低时 FEC 无感修复,出现突发性丢包时 NACK 快速补传。实测数据显示,80% 丢包率下语音通话依然可以维持流畅,断网 3 至 5 秒后可自动恢复对话——这个能力对部署在地铁、地下车库、户外或信号不稳定地区的语音 Agent 场景,意义相当实际。

传输层做的事,和模型层做的事,分工是清晰的:模型负责听懂和回答,传输层负责把声音稳定地送到和送回来。两件事缺一不可,也互相不可替代。无论上层接的是 Parakeet 还是 Deepgram,是 Voxtral 还是 ElevenLabs,传输层面对的问题是一样的,解法也是一样的。

四. 声网对话 AI 引擎:为什么叫”开放生态”

声网在 2025 年 3 月发布了对话式 AI 引擎,底层基于开源框架 TEN Framework 构建。这个引擎的设计逻辑,和当前开源语音 AI 爆发的背景是高度契合的。

它的核心思路是把两件事拆开来做:模型层完全开放,传输和实时交互层做稳做深。

模型层:接什么都行

声网对话 AI 引擎支持接入几乎所有主流 LLM,包括 DeepSeek、ChatGPT、通义千问、智谱清言、豆包等,也支持开发者自建的模型。TTS 侧支持全球主流语音合成供应商自由切换,并允许通过供应商定制音色接入。

这个开放性对正在评估开源方案的团队来说很务实。开源模型的迭代速度比商用 API 快得多,今天的最优选择三个月后可能就不是了。如果每次换模型都要重新搭管道,维护成本会相当高。声网的架构把这个切换成本压到了最低。

接入速度上,声网对话 AI 引擎提供了 Playground 调参环境,开发者在 Console 后台开通服务后,2 行代码、15 分钟内即可完成从文本大模型到可说话的对话式 AI Agent 的整个部署。

实时交互层:打断、降噪、弱网,这些细节决定体验

模型选好了之后,用户真正感知到的对话质量,很大程度上取决于交互层的细节处理。

- 智能打断是体验差异最明显的一个点。声网自研的 AI VAD 可以适应人类说话时的停顿、语气词和节奏变化,在用户开口时准确识别并立刻停止 AI 输出,打断响应延迟低至 340ms。这个数字意味着用户打断 AI 后,等待时间在 0.3 秒左右,基本达到自然对话的感受。

- 背景噪声过滤对真实部署场景同样重要。声网的处理方案能屏蔽背景人声与噪声,在商场、地铁站、咖啡厅等嘈杂环境下依然能保证 ASR 识别的准确率。AI 不会因为背景人声误以为用户在说话而错误触发打断。

- 多端兼容方面,声网的音视频 SDK 支持 30000 多种终端机型,覆盖 iOS、Android、Web 以及各类嵌入式硬件平台。这对同时需要服务 App 用户、Web 端用户和 IoT 设备的产品来说,省去了大量多端适配的工作量。

五. 私有部署:开源模型时代新出现的需求

开源模型的兴起带来了一个之前不那么突出的需求:私有化部署。

开发者选择自托管,通常基于“数据不想发给第三方 API”的考量。医疗机构不希望患者的语音数据经过外部服务器,金融机构有数据不出境的合规要求,企业内部的智能助手也不希望通话内容被记录在任何云端系统里。

但自托管模型解决的只是数据存储的问题。音频在传输过程中同样经过网络节点,如果传输层走的是公共互联网,数据链路同样存在暴露风险。真正意义上的私有化,需要传输层和模型层同时满足要求。

声网的架构支持混合部署:模型跑在客户自己的私有云或本地服务器,传输层使用声网 SD-RTN™ 的全球网络。两者可以解耦配置,客户的语音数据在传输过程中通过声网的节点加密中转,不经过任何模型供应商的服务器。

合规认证方面,声网通过了 ISO/IEC 27001、27017、27018、27701 系列认证,完成了 SOC 2 Type 2 鉴证,符合 GDPR、HIPAA、CCPA、COPPA 等相关法规要求。出海 IoT 产品在欧美上架时,合规认证往往是必要条件,声网的认证体系可以直接支持这部分审查流程。

硬件侧,声网还在 2026 年初将核心硬件抽象层项目 AOSL 在 GitHub 全面开源。AOSL 在操作系统、芯片与 RTC 传输层之间定义了一套标准接口,目前已完成对乐鑫 ESP32、博通集成 BK7258 等主流芯片的适配,支持 RTOS 和 Linux 操作系统。对于做智能音箱、AI 玩具、可穿戴设备的硬件开发者来说,接入 AOSL 就等于把声网的实时传输能力直接带到设备里,不需要从零处理芯片级的音频管道适配。

六. 模型之外,RTC 是统一底座

这波开源语音 AI 的爆发,给了开发者更大的灵活性,同时也让语音 Agent 的部署路径变得更加多样化。有人会选闭源 API 快速落地,有人会自建开源全栈控制成本,有人会混合使用。

但不管选哪条路,都需要考虑音频怎么在用户和模型之间可靠、低延迟地流动。

声网对话 AI 引擎的价值,体现在它不和任何一款模型绑定,也不阻止开发者换模型。模型层的选择是开发者自己的事,声网负责的是传输、打断、降噪、弱网这些和模型选型无关、但和用户体验高度相关的环节。

模型的选择可以随时调整,今天的最优解明天就可能被更好的方案替代。但传输层积累下来的全球节点覆盖、弱网对抗算法和实时交互能力,是需要时间沉淀的东西,也是开源模型爆发之后依然无法被替代的部分。

这也是为什么声网把自己定位成”对话 AI 的关键基础设施”。

首页

首页