2026年3月26日,谷歌正式发布 Gemini 3.1 Flash Live,将其定位为”迄今为止质量最高的音频与语音模型”,同步上线 Google AI Studio 的 Gemini Live API 供开发者预览接入,并用它驱动 Gemini Live 和 Search Live 的全球扩展。

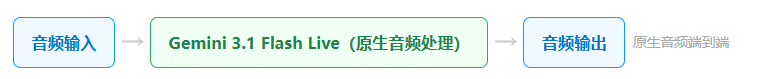

这次发布的意义不只是性能数字的刷新。Gemini 3.1 Flash Live 代表的是一次架构层面的转变:把过去需要 VAD、ASR、LLM、TTS 四段串联才能跑通的实时语音链路,折叠进单一原生模型完成。这件事对正在构建实时语音产品的开发者和决策者来说,选型逻辑会因此发生变化。

本文拆解 Gemini 3.1 Flash Live 的技术核心、基准数据、API 接入方式,以及这次发布背后更大的行业趋势。

一. Gemini 3.1 Flash Live 是什么

先厘清一个容易混淆的命名问题。Gemini 3.1 Flash Live 不是”Gemini 3.1 Flash”的通用版本,它是 Flash 家族里专门为实时语音交互打造的独立分支,官方全称是 Gemini 3.1 Flash with Native Audio Capabilities。根据谷歌 DeepMind 发布的模型卡,它基于 Gemini 3 Pro 构建,支持音频、图像、视频和文本的多模态输入,上下文窗口最大 128K token,输出支持音频和文本,输出上限 64K token。

它的前身是 2025 年底推出的 Gemini 2.5 Flash Native Audio。从命名演进可以看出谷歌对这条产品线的定位越来越清晰:把实时语音交互作为 Flash 家族独立承载的功能层,而不是在通用模型上打补丁。

这次从 2.5 到 3.1 的跨版本升级,背后是更大规模的基础模型换代,谷歌选择把最新旗舰能力直接用来驱动实时语音这条线,本身也是一个信号,说明实时对话在谷歌内部的战略权重正在提升。

二. 架构变了什么:原生音频处理的真正含义

理解 Gemini 3.1 Flash Live 的核心,绕不开”原生音频处理”这个概念。它的对立面是过去两年绝大多数实时语音产品采用的串联架构,理解了这个对比,才能真正看懂这次发布的技术价值。

传统串联架构的问题在哪里

过去搭建一条实时语音对话链路,通常要把四个独立模块依次接起来:

每一段都有自己的延迟,叠加起来之后,即便每段优化得不错,端到端的延迟也很容易超过 500ms,用户说完话要等半秒多才听到回复,交互感受非常生硬。更麻烦的是,ASR 在把语音转成文字的过程中,说话人的语气、语速、停顿、情绪色彩全部丢失了,LLM 看到的只是干净的文字序列,无法感知”这个用户说这句话时听起来很不耐烦”。

Gemini 3.1 Flash Live 把这四段折叠进了单一模型。音频直接进入模型,模型直接输出音频,中间没有文字这个中转媒介。这带来两个根本性的改变:延迟的叠加效应消失了,语气和声学细节在整个处理过程中得以保留。

谷歌在发布材料中描述这一架构转变时用了”collapse the transcribe-reason-synthesize stack”这个说法,把原来的三段推理栈折叠进单一流程。对开发者来说,这意味着不再需要维护三套模型、三套 API 调用和三套错误处理逻辑,系统复杂度大幅降低。

情感感知:超出”听懂说了什么”的能力边界

原生音频处理让模型能做到以前做不到的一件事:听懂说话人的状态,而不只是听懂说话内容。

Gemini 3.1 Flash Live 具备谷歌称之为”Affective Dialogue(情感对话)”的能力,在 Gemini Enterprise for Customer Experience 场景下,模型可以实时感知用户语气中的焦虑、困惑或不满,并相应调整自己的回复风格和语调。一个用户声音里带着明显的急躁,系统能识别到并自动切换成更简短、更直接的回应方式,而不是继续用既定的客服话术照章输出。

这个能力对智能客服场景意义很大。传统系统把用户说的话转成文字再分析,情绪判断依赖关键词匹配,准确率有限。原生音频处理让情感感知从文字层面下沉到声学层面,准确率和实时性都有本质提升。

三. 核心能力与基准数据

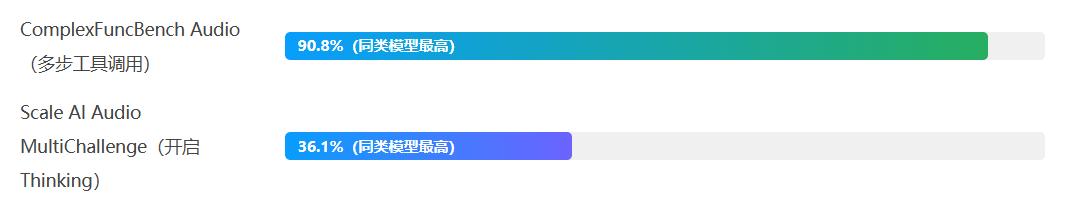

发布材料中,谷歌给出了两个关键基准数字,可以用来评估 Gemini 3.1 Flash Live 在同类模型中的位置。

来源:Google Blog《Gemini 3.1 Flash Live: Making audio AI more natural and reliable》,2026年3月26日

ComplexFuncBench Audio 测的是模型在带语音的多步函数调用场景下的准确率,90.8% 的得分意味着在真实对话过程中触发外部工具(比如查询库存、调用支付接口、更新工单)的成功率已经达到相当可靠的水平,这对需要把语音 Agent 接入业务系统的开发者来说是一个实质性的进步。

Scale AI Audio MultiChallenge 评测的是模型在嘈杂环境、被打断、话题切换等复杂真实场景下的综合表现。开启”Thinking”模式后 36.1% 的得分目前在开放基准里排首位。

除了基准数据,谷歌还披露了几项具体能力提升:

| 能力维度 | 具体变化 |

|---|---|

| 对话上下文长度 | 可跟随对话线索的能力是前代(2.5 Flash Native Audio)的 2 倍,更适合长篇幅的复杂对话场景 |

| 背景噪声过滤 | 在交通噪声、电视背景音等嘈杂环境下,识别目标语音的准确率明显提升 |

| 多语言支持 | 支持 90+ 语言实时多模态对话,无需手动指定语言,模型自动识别切换 |

| 复杂指令遵循 | 对复杂系统提示词(System Prompt)的遵从率大幅提升,对话过程中碰到话题跳转依然能保持指令执行的稳定性 |

| 工具调用 | 在实时对话中触发外部工具的能力显著增强,ComplexFuncBench Audio 得分 90.8% |

| SynthID 水印 | 所有音频输出内嵌不可感知的数字水印,可通过软件检测识别 AI 生成来源 |

四. 已经在用了:Verizon、Home Depot 的真实部署

这次发布不只是实验室里的技术预览。谷歌在公告中提到,Verizon 和 The Home Depot 已经在测试 Gemini 3.1 Flash Live,其中 Home Depot 是用在联络中心的客户交互场景里。LiveKit 也作为官方合作伙伴给出了正面反馈。

Home Depot 是北美最大的家居建材零售商之一,联络中心每天处理的通话量极大,对语音 AI 的稳定性、准确率和工具调用能力要求都很高。能在这个体量的企业生产环境里跑起来,说明 Gemini 3.1 Flash Live 的工程成熟度已经越过了纯学术验证的阶段。

来源:Google Blog《Gemini 3.1 Flash Live: Making audio AI more natural and reliable》,Droid-life,2026年3月26日

与此同时,谷歌将 Gemini 3.1 Flash Live 用来驱动 Search Live 的全球扩展,覆盖 200 多个国家和地区,让用户可以用语音加摄像头实时与搜索进行多模态对话。这个规模的流量验证,对开发者评估模型的可靠性也是一个参考维度。

五. 开发者接入:Gemini Live API 的关键细节

Gemini 3.1 Flash Live 目前通过 Google AI Studio 的 Gemini Live API 向开发者开放 Preview 访问,企业客户可通过 Gemini Enterprise for Customer Experience 使用。以下是开发者需要掌握的技术细节。

连接方式:有状态的 WebSocket 持久会话

Gemini Live API 不是普通的 REST 接口。它基于 WebSocket 建立持久双向流,整个对话过程中连接始终保持,客户端持续向服务端推送音频流,服务端实时返回音频块和对应的文字转录。这种架构和”发一个请求等一个回复”的传统 API 模式完全不同,对开发者的后端架构有一定要求。

音频格式上,输入要求 16kHz PCM 单声道,输出返回 24kHz PCM。格式不匹配会导致输出音频混乱或静音,这是接入时最常见的踩坑点。根据开发者实测记录,p50 首 token 延迟在 320ms 左右,p95 在 780ms 左右。

部署架构:推荐服务端代理模式

谷歌官方文档给出了两种部署架构选择。原型阶段可以用客户端直连(通过临时 token),前端直接建 WebSocket 到 Gemini Live API,延迟最低,搭建最快。但生产环境强烈推荐服务端代理模式:客户端把音频推到自己的后端服务器,由服务器持有 WebSocket 连接与 Gemini 通信。这样做可以保护 API 密钥、在服务端做内容审核和日志记录、并集成内部业务系统。

需要注意的是,会话默认最长 10 分钟,超时后连接会断开。如果产品需要支持更长时间的对话,开发者要自行实现会话续接逻辑,在重连时把上下文状态带过去,否则用户会感知到对话”失忆”。

第三方 RTC 框架的官方支持

谷歌在官方 GitHub 示例仓库(google-gemini/gemini-live-api-examples)里明确列出了多个支持通过 WebRTC 或 WebSocket 接入 Gemini Live API 的第三方框架,这意味着开发者不必从零实现 WebRTC 栈,可以基于这些框架快速构建生产级语音 Agent,同时利用它们各自提供的全球节点传输能力。

六. 模型之外:实时语音 Agent 落地还需要什么

Gemini 3.1 Flash Live 把语音 AI 的模型层能力提升到了一个新台阶,但把它真正跑在生产环境里,还有一些模型解决不了的问题。

最典型的是传输层的延迟问题。Gemini Live API 的 p50 首 token 延迟大约在 320ms,但这只是模型侧的推理时间,不包含音频从用户设备到服务器的传输延迟,以及音频从服务器回到用户设备的传输延迟。在弱网环境或跨国场景下,传输层的往返延迟完全可以把端到端体验拉回到 800ms 甚至更高,把模型层省下来的时间全部吃掉。

除延迟之外,生产级语音 Agent 还有几个常见挑战值得在选型时提前考虑:

| 挑战 | 具体表现 | 模型层能解决? |

|---|---|---|

| 弱网稳定性 | 移动网络、海外网络下音频流传输不稳定,导致识别率下降或连接中断 | 否,需要 RTC 传输层处理 |

| 打断处理 | 用户打断 AI 说话时,AI 应立即停止输出并重新响应 | 模型支持 Barge-in,但传输层需配合快速清空缓冲 |

| 全球延迟一致性 | 不同地区用户的端到端延迟差异大,部分地区体验远差于本地 | 否,需要全球边缘节点覆盖 |

| 会话管理 | 10 分钟会话上限,网络抖动导致连接断开后的上下文丢失 | 需开发者自行实现续接逻辑 |

| 背景噪声 | 用户环境噪声(工厂、户外、嘈杂家庭)影响识别准确率 | 模型层有改善,复杂场景仍需传输层 AI 降噪 |

结语

把 Gemini 3.1 Flash Live 放在更大的行业背景里看,会发现这个月实时语音 AI 领域的密度异常高:NVIDIA 在 GTC 2026 上发布了 Nemotron 3 VoiceChat 全双工语音模型,xAI 开放了 Grok TTS API,ElevenLabs 的 Scribe v2 以 2.3% WER 刷新了商用 ASR 基准,谷歌这次又用 Gemini 3.1 Flash Live 补全了实时对话侧的旗舰能力。

这种集中爆发不是巧合。过去一年,语音 Agent 的商业化落地速度明显加快,联络中心、医疗、教育、零售等行业的真实部署需求正在推动模型层快速迭代。例如,声网对话式 AI 引擎也已在智能硬件、教育口语陪练、虚拟陪伴等场景完成落地。

从这个角度看,Gemini 3.1 Flash Live 的发布有两层含义。第一层是模型能力本身:原生音频端到端架构、情感感知、90.8% 的工具调用准确率,这些让实时语音 Agent 的交互质量上了一个台阶。第二层是行业信号:实时语音已经从探索阶段进入规模化落地阶段,模型层的能力正在快速成为基础设施,真正拉开产品差距的战场开始向传输层、稳定性、全球覆盖能力转移。

首页

首页