在视频采集中实现图像实时处理与压缩,核心目标是:在图像帧刚从传感器生成时就对其进行必要的预处理,同时将数据压缩为更小的数据流量,以便于后续低延迟传输或存储。这种能力对于实时通信(如视频通话、实时直播)、监控系统(边缘采集与传输)等场景至关重要,因为它直接影响系统的延迟、带宽占用和整体用户体验。

在视频采集阶段的实时处理与压缩不是传统的“采集完再压缩”,而是边采集边处理、边压缩边输出的流水线式处理架构,其实现需要协调图像预处理流水线、压缩算法和实时编码执行机制,并充分利用硬件/软件协同加速方式。本文将从采集链路、图像实时处理、核心压缩原理及实现方法等层面详细解析这一问题。

一. 视频采集的数据通路与实时处理为何必要?

视频采集是从摄像头等传感器获取像素数据的过程。原始数据通常由光学镜头形成的光照信号在传感器上转换为电信号,并经过模数转换(ADC)得到数字图像信号。这些像素数据随后进入图像信号处理模块(ISP)进行初步优化,然后通过接口传输给后续处理单元。

真实场景中,视频采集系统不能单纯等待完整的一段帧序列再进行后端处理,否则会导致明显的延迟。例如,在一个 1080p、30 fps 的未压缩视频流中,数据量可能达到数十 MB/s 级别,这对于网络传输和存储带宽都是巨大的负担。图像预处理和压缩必须在采集阶段尽早完成,才能缩减数据量并满足实时性要求。

实时性约束指标

实现实时处理与压缩需要考虑以下指标:

- 帧率(FPS):采集和压缩必须支持目标帧率,例如 30 fps、60 fps 甚至更高。

- 处理延迟(Latency):从采集到压缩完数据输出的延迟需在可接受范围内,否则系统将出现卡顿或延迟。

- 带宽和码率:压缩后的数据必须在可用网络带宽范围内进行传输。

在实时链路中,这些指标不是孤立的,而是相互影响——提高压缩程度通常可以降低带宽需求,但可能增加处理延迟和复杂度。因此,工程上多采用并行流水线方式来减轻单点处理延迟。

二. 图像实时处理:采集阶段数据预处理为何与如何做?

图像预处理的意义

在进入压缩之前,对图像数据进行预处理可以提高压缩效率并改善压缩质量。在视频采集阶段常见的图像预处理任务包括:

- 噪声抑制:传感器噪声通常会降低压缩效率,通过滤波等算法降低噪声可以帮助压缩算法更好地提取有效信息。

- 色彩校正与光照调整:调整白平衡、曝光等可以使图像更适合编码。

- 格式与色彩空间转换:例如将原始的 RGB 图像转换为更适合压缩的 YUV 色彩空间;进一步可以将 YUV444 转换为 YUV420,这样可以减少空间冗余并降低数据量。

预处理通常集成在图像信号处理器(ISP)或专用处理单元中,这些硬件模块可以在采集过程中实时完成。ISP 模块在摄像头中是一类常见硬件,它可以在帧刚到达时执行算法优化,然后将处理后的数据送往后续单元。

并行流水线与实时性保障

在实时视频采集中,流水线(pipeline)是核心设计思路,它的目标是将整个处理流程拆分成多个阶段,并并行执行多个阶段的任务,从而实现更高的整体吞吐量和更低的延迟。这种思路本质上类似于电脑处理器中的指令流水线,即将一条任务拆成多个阶段执行,并让不同阶段同时处理不同任务,使整体处理速度大幅提升。在视频领域,这种机制尤为重要,因为一帧未处理的图像数据从采集到压缩输出的时间必须尽可能短,否则就会造成延迟积累、卡顿或丢帧等问题。

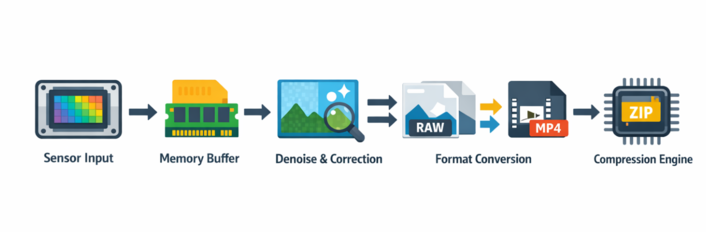

在视频采集的实时处理与压缩链路中,流水线设计如下:

像素数据从传感器输入 → 进入内存缓冲 → 并行执行去噪/校正 → 格式转换 → 进入压缩引擎

这种流水线设计实现了各阶段并行协作执行: 处理器同时处理不同阶段的不同帧; 不再等待整个帧处理完才进入下一步,而是采用缓冲区和队列机制让数据在阶段之间流动。 这种方式与传统的“提取 → 处理 → 压缩 → 再输出”串行模式相比,能够明显降低瓶颈延迟。

三. 实时压缩的核心原理与标准框架

图像压缩本质上是利用空间冗余和时间冗余来缩减数据量,这在视频领域尤为重要:

- 空间冗余:同一帧内相邻像素通常具有高度相关性,可以用更少的数据存储或传输差异信息。

- 时间冗余:相邻帧之间往往变化较小,通过预测和差异编码可以大大降低数据量。

现代视频压缩技术通过这些方法实现高效压缩,而实时实现则要求这些算法在采集阶段就能执行。

核心压缩技术组件

一个典型的视频压缩编码器主要包括以下几种核心技术:

- 变换编码(如 DCT):将空间域的数据转换到频率域,使得较大的能量集中于少数系数,有利于压缩。

- 运动补偿与预测:通过分析时间域内帧与帧之间的运动信息,只保存变动部分,从而大幅减少数据。

- 熵编码与量化处理:对变换后的系数进行量化和熵编码以进一步压缩数据表示。

这些关键技术组合是几乎所有视频编码标准的基础,例如 H.264、MPEG 系列等。

标准框架与实时性

许多主流视频压缩标准本身并未区分实时与非实时环境,但它们设计的编码框架支持实现实时压缩:

- H.264/MPEG-4 AVC:是目前广泛用于实时视频场景的压缩标准之一,其设计支持高效的运动估计和变换编码。

- 近代标准(如未来 H.267):针对更高分辨率和实时性需求,业界正在开发更高效、更低延迟的标准。

实时压缩的关键并不在于标准本身,而是标准在实现时的工程优化(如并行化、硬件加速、参数调整等)。

四. 视频实时压缩的实现方法

实现实时压缩需要在采集链路中构建一个完整的 压缩工作流,并且尽可能减少处理延迟和资源消耗。

色彩空间与采样转换

通用做法是将采集的 RGB 像素数据转换为更适合压缩的色彩空间(例如 YUV),这种转换可以通过矩阵操作直接在硬件中实现,然后对转换后的数据进行采样格式调整,如从 YUV444 转换为 YUV420,这一过程可以显著降低数据量,同时仍保持可接受的视觉质量。

这是采集端压缩常见步骤之一,因为直接从原始 RGB 压缩效率较差且耗费处理资源。

压缩单元与硬件加速

为了实现实时压缩,压缩工作流通常在硬件层面实现:

- 压缩 IP 核:在 FPGA/ASIC 等硬件中实现压缩算法,并行处理每个帧的数据块,然后输出压缩比特流。

- 并行分块压缩:将一帧图像分成多个压缩块并行编码可以显著提高实时处理速度。

这种硬件加速方式在视频采集设备(如监控设备、采集卡)中是实际应用的主流方式。

动态参数调整与压缩策略

压缩算法的另一个关键在于根据场景和网络条件动态调整:

- 码率控制:在带宽紧张时降低码率以保证实时性;网络良好时提高码率以提升质量。

- 区域兴趣压缩:只对关键区域(例如人脸区域)保留较高质量,而对背景压缩得更低,从而进一步降低整体带宽需求。

此外,一些先进的压缩实现还借鉴内容分析结果辅助压缩,这种思路在一些研究专利中体现为结合图像特征检测改进的压缩方式。

结语

在视频采集中实现图像的实时处理与压缩,是一个涵盖 数据采集、图像预处理、压缩算法与工程实现 等多层面协同的问题。核心逻辑是:

- 尽早对采集到的图像进行处理,减少噪声与冗余,为压缩做准备;

- 将压缩作为采集链路的一个实时阶段,通过流水线、并行、硬件 IP 等方式降低延迟;

- 利用成熟的压缩标准(如 H.264 等)及其实现机制,结合硬件加速和动态策略实现低延迟压缩;

通过这些实现机制,可以在实际系统中构建高效、低延迟的采集端实时处理与压缩能力,为后续通信、存储和展示环节提供良好的基础。

首页

首页